Axiom 01

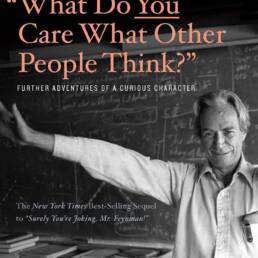

Der Feynman-Ansatz: Tief rein, auch wenn es fremd ist.

Gute Ethik-Assessments beginnen nicht mit Ethik. Sie beginnen mit Verstehen. Ich grabe mich in Themen ein, die ich bis dahin nicht kannte – systematisch. Schnell, aber nicht oberflächlich.

Das kann ich, weil mein Hintergrund genau darauf ausgelegt ist: Philosophie, Kunstgeschichte und Musikwissenschaft im Studium. MBA in Innovationsmanagement und Zukunftsforschung. Mehr als zehn Jahre B2B-Marketing in Nischenfeldern von Hotel Revenue Management bis Finance-Szenario-Simulationen. Zertifikate in AI in Healthcare (Stanford), NIST AI Risk Management, Design Thinking, Consumer Neuroscience.

Das hält das Denken fit und kommt nicht ganz zufällig. Sondern, weil unterschiedliche Denkweisen, Fachsprachen und operative Realitäten zusammenkommen müssen, wenn man in fremden Kontexten schnell wirklich verstehen will.

Denn: Ein tragfähiges Ethik-Assessment kann nicht an der Oberfläche schürfen. Wie funktioniert das Produkt? Wo genau greifen die Regularien? Was passiert auf operativer Ebene – nicht auf irgendeiner Metaebene? Genauso wie Erfolg oft im operativen Detail entschieden wird, wird EU-Compliance dort entschieden, wo die Regeln tatsächlich wirken.

Ergo:

Was ich nicht kenne, lerne ich – bevor ich beurteile.

Verständnis ist keine Voraussetzung für Effizienz. Aber für Richtigkeit.

Oberflächliche Assessments sind keine Assessments. Sie sind Alibi-Dokumente.

Axiom 02

Ethik ist keine Theorie. Und kein Elfenbeinturm-Gebrabbel.

Es steht tausendfach geschrieben – in Netz-Artikeln, Beraterfolien, halbseidenen Positionierungen: Ethik sei eine „Theorie“. Das stimmt nicht. Und es ist keine Kleinigkeit, dass es nicht stimmt.

Das zentrale Definiens des Theoretisierens fehlt der Ethik: Sie kann keine Phänomene nach objektiv erkennbaren Regelmäßigkeiten klassifizieren und auf dieser Basis Prognosen über zukünftige Ereignisse erstellen. Das ist nicht ihr Job.

Aber Ethik ist genauso wenig eine Praxis im direkten Sinne. Man wendet sie an – man betreibt sie nicht. Und aus dem Elfenbeinturm kommt sie auch nicht: Ethik erlaubt uns, Systeme zu bauen, die helfen, gutes, schlechtes – und ja, auch dusseliges – Handeln zu bewerten.

Machen wir uns nichts vor: Die eine Ethik gibt es nicht. Ethik liefert keine Gebrauchsanleitung für jede konkrete Situation. Mit ihr bauen wir Gerüste – allgemeine Prinzipien, Maßstäbe, vielleicht auch Vorzugsregeln für typische Problemlagen.

Manches ist gut, obwohl das Ergebnis Mist ist. Und Manches ist Mist, obwohl das Ergebnis eigentlich gut ist.

Klingt abgehoben? Ist es nicht. EU-Compliance bedeutet: die auf jahrzehntelanger, demokratischer Praxis beruhenden Aushandlungsprozesse zwischen Ethik, Forschung, Wirtschaft, Gesellschaft und Recht so in die Unternehmensrealität übersetzen, dass Regelwerke nicht nur eingehalten werden, sondern Orientierung stiften – und im besten Fall neue Handlungsoptionen sichtbar machen.

Hier geht es nicht um Theorie. Hier geht es um verantwortbare Praxis. Um Orientierung für echte Entscheidungen.

● Beispiele

Ethik und Compliance

Gute Beispiele voraus: Wie Ethik & Compliance zu besseren Abläufen und Produkten führen (können):

EU AI Act

KI-gestützte Bewerberauswahl

SaaS HR

Ausgangslage: Das Unternehmen setzt ein ML-Modell ein, das Lebensläufe automatisch bewertet und Kandidaten für Erstgespräche auswählt. Das System fällt nach EU AI Act Klassifikation unter Hochrisiko-KI (Annex III, Beschäftigung).

Ethische Herausforderung: Systematischer Bias gegenüber Bewerbenden lässt sich nicht gänzlich ausschließen (beispielsweise bzgl. Lücken im Lebenslauf, ethnische Zugehörigkeit über Namen, etc.).

Lösung: Im Reporting wird die Implementierung eines Review-Prozesses empfohlen (bspw. der Art, dass eine menschliche Überprüfung aller Ablehnungen erfolgen muss (Human-in-the-Loop-Prinzip). Zudem sollten eine Explainability-Dokumentation (SHAP-Values) und ein Conformity Assessment in den Prozess integriert werden. Der Aufbau eines internen AI Compliance Officers als eigene Rolle erscheint wenig zielführend, die Verantwortung für die AI Compliance soll aber einer Rolle im Unternehmen übertragen werden.

DSGVO & Datenschutz

Satellitenbild-Analytik

GeoTech / SaaS

Ausgangslage: Das Unternehmen analysiert hochauflösende Satellitenbilder für Kunden aus Versicherung, Landwirtschaft und Stadtplanung – bei dieser Auflösung werden einzelne Personen und Fahrzeuge erkennbar.

Ethische Herausforderung: Massenüberwachung through the Backdoor: Versicherungskunden kamen auf die Idee, Analysen zur Verhaltensmustererkennung auf Privatgrundstücken zu beauftragen.

Ergebnis: Im Reporting wird die Entwicklung einer internen Use-Case-Policy empfohlen: automatisches Blurring aller Personen unter 50 m Abstand. Das Privacy-by-Design-Prinzip könnte schon im API-Layer integriert werden – personenbezogene Features werden serverseitig entfernt, bevor Daten den Kunden erreichen. Weitere Empfehlung: DPIA für jeden neuen Vertragspartner verpflichtend machen (→ DSGVO Art. 25 erfüllt, DPIA-Prozess).

Medizinethik

KI-Diagnoseassistenz

MedTech

Ausgangslage: Das Unternehmen entwickelt ein KI-System, das MRT-Aufnahmen auswertet und Frühzeichen bestimmter neurologischer Erkrankungen erkennt – mit hoher Sensitivität, und bevor klinische Symptome auftreten.

Ethische Herausforderung: Prädiktive Diagnosen ohne klinische Bestätigung: Patienten erhalten Wahrscheinlichkeitswerte für eine Erkrankung, für die es keine Therapie gibt. Da stellen sich Fragen zu informierter Einwilligung, psychologischer Belastung und Versicherungsdiskriminierung.

Lösung: Die Ethaas-Empfehlung ist in diesem Fall knapp – für Innovationen im medizinischen Bereich fehlen uns die Kapazitäten. Angeregt wird ein mehrstufiger Informed-Consent-Prozess. Zudem: Ergebnisse sollten nur an behandelnde Ärzte, nie direkt an Patienten übermittelt. Und: Eine dedizierte und qualifizierte Medizinethikkommission sollte als permanentes Gremium eingebunden werden.

Maschinensicherheit

Kollaborative Robotik

Industrial Tech

Ausgangslage: Das Unternehmen vertreibt Roboterarme (insbesondere für KMU). Die Systeme arbeiten ohne Schutzkäfig neben menschlichen Mitarbeitern – klassifiziert nach Maschinenrichtlinie 2006/42/EG.

Ethische Herausforderung: Kleinbetriebe konfigurierten die Roboter selbst und deaktivierten Sicherheits-Stopp-Funktionen, um Taktzeiten zu erhöhen. Führte zu mehreren Beinahe-Unfällen.

Lösung: Der Report empfiehlt ein paar technische und ethische Maßnahmen: Safety-Parameter per Firmware gegen Überschreibung sperren, Einführung eines Onboarding-Zertifikats für Betreiber. und eventuell ein Incident-Reporting-System für Mitarbeiter der Kundenbetriebe eingerichtet.